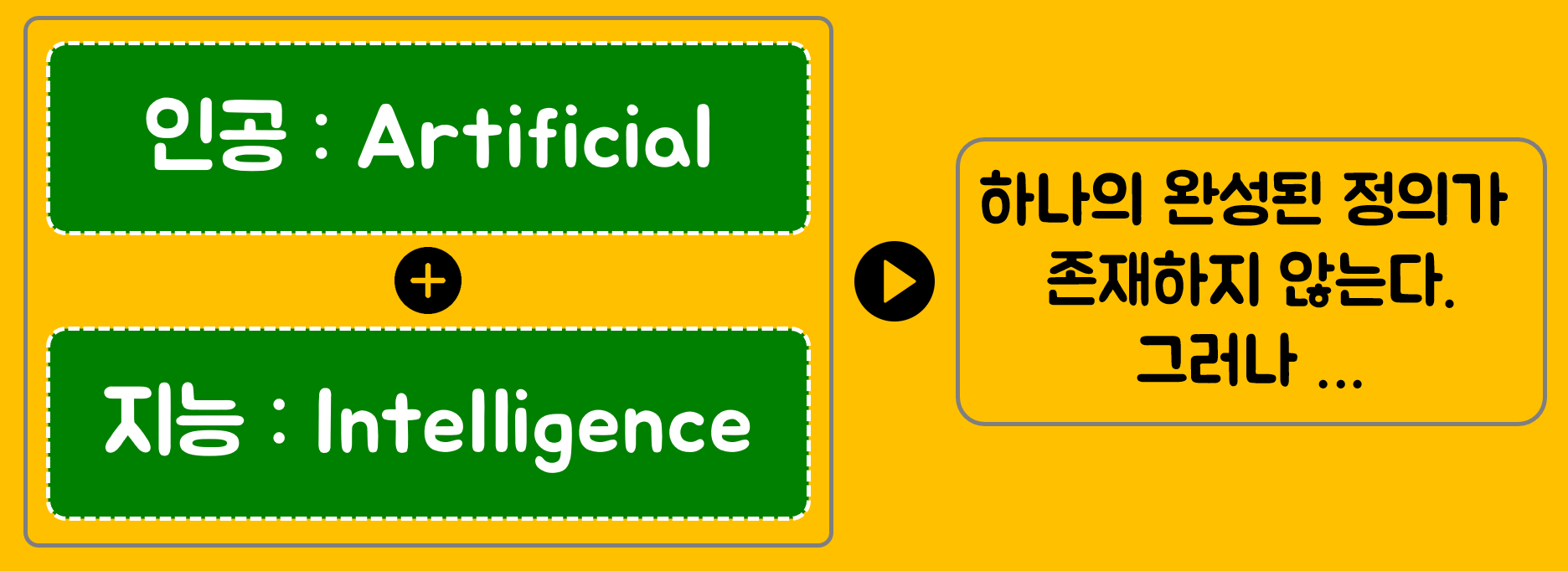

인공 지능의 역사를 알려면 여러가지를 알아야합니다. 재미있게 공부해봅시다. 통상 인공 지능의 역사를 꺼내면, 다트머스 회의(Dartmouth College worksho)을 언급하거나 앨런 튜링(Alan Mathison Turing)을 언급합니다. 저는 그 보다 이전에 전조로서, 우리 인류가 꿈꿔온 것이 무엇인지를 살펴보도록 하겠습니다. 인류의 오랜 꿈 중 하나는 사람을 닮은 무엇을 만드는 것이었습니다. 우리는 인간을 닮은 기계를 추구하기 위해서, 사고와 이성의 철학적 관점, 자동화관점, 수학적 관점을 비롯한 다양한 관점에서 우리는 하나씩 문제를 내고, 그 문제의 답을 해결해왔습니다. 수많은 질문과 고민의 역사가 있었습니다. 인간을 닮은 기계에 대해 고민은 기계의 발달과 인간의 지능이나 이성에 대한 구현..